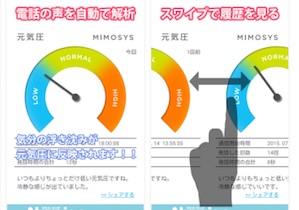

スマホで話すだけで健康状態がわかる!?(画像はMIMOSYS(ミモシス)のダウンロードサイトより)

日経Biz Gate(2月22日)によれば、東京大学大学院医学系研究科音声病態分析学講座を主宰する光吉俊二特任講師と徳野慎一特任准教授は、ICT(情報通信技術)を医療に活用し、2014年9月からスマホで話すだけで、元気か不調かの健康状態を知らせる音声病態分析の研究に着手。

2015年4月からは、東大が推進する研究プロジェクト「自分で守る健康社会」にも参加し、「入院を外来に、外来を家庭に、家庭で健康に」のコンセプトに基づき、自分で守る健康社会の実現に努めている。

音声病態分析とは何か? 光吉特任講師によれば、人の声に含まれるさまざまな感情や興奮の度合いを測定し、健康状態を判断する解析法、それが音声病態分析だ。

人間の喜怒哀楽の感情は、大脳から副交感神経系の反回神経(迷走神経)を経て、心臓や声帯につながって生じる。たとえば、緊張すると心臓がドキドキする。声が上ずる。体が強ばる。すべて反回神経の仕業だ。

心臓の高鳴りも声のうわずりもストレス反応も、自分の意思でコントロールできない不随意運動のため、ホンネがそのまま表れやすい。一方、たとえば、楽しく会話している時なら、自分の意思で口や舌などを動かす随意運動なので、言葉のニュアンスや感情の起伏を意識的に変えている。

徳野特任准教授によると、不随意運動と随意運動を組み合わせて分析すれば、うつ病や脳梗塞で通院している患者と健常者をほぼ完全に判別できることから、音声病態分析によって、より適切な治療が進められるようになったという。

音声病態分析の研究は、どのような経緯から始まったのだろう?

1990年代、光吉特任講師は、CG映画の制作に関わったことから、音声認識研究をスタート。CGソフトは使いづらく、音声認識技術も遅れていたが、感情の微妙な動きは脳から声帯に伝わることから、感情と音声を工学的に分析できると判断した。

光吉特任講師は「喜びを黄、怒りを赤、悲しみを青、平静を緑」の4つの音声グループに分類したうえで、約2800人に及ぶ約3万の発話に基づいて4つの感情を表す音声パターンのデータベースを完成。

声帯の震えから興奮の度合いを測定する手法や、声に含まれる4つの感情の割合と興奮の度合によって感情をリアルタイムで判定できるソフトも開発した。